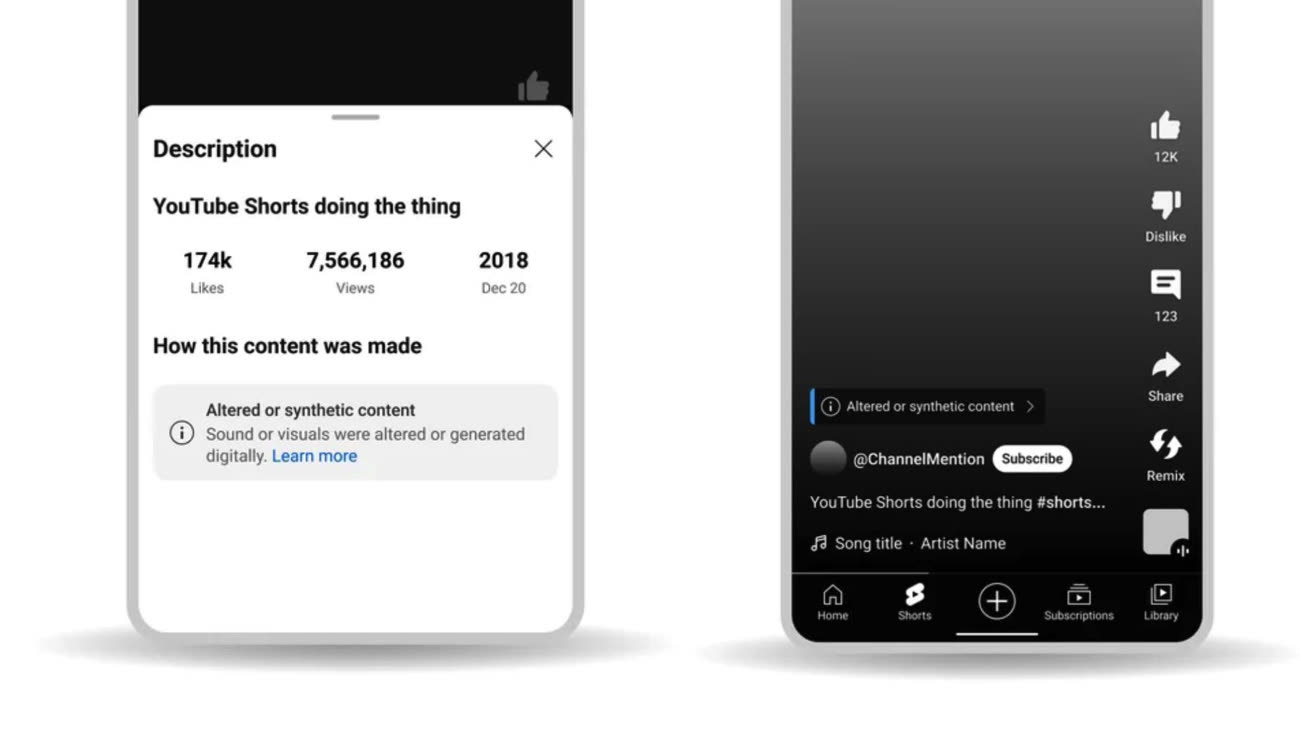

YouTube hausse le ton contre les images et les voix générées par IA. Dans un billet de blog, Google a présenté quelques nouveaux outils permettant d'alerter les spectateurs sur la présence de contenu artificiel dans une vidéo. Cela va se traduire par une nouvelle option offrant aux créateurs d'indiquer si leurs vidéos comportent des morceaux générés par IA. Pour les spectateurs, un avertissement apparaîtra au côté des vidéos, qui pourra être plus imposant pour celles traitants de « sujets sensibles ».

Google explique que l'option pourra notamment s'appliquer aux vidéos « réalistes » dépeignant un évènement qui n'a jamais eu lieu, ou quelqu'un en train de dire ou de faire quelque chose qu'il n'a pas réellement fait. « Ceci est particulièrement important dans les cas où le contenu aborde des sujets sensibles, tels que les élections, les conflits en cours et les crises de santé publique », précise Google.

Les utilisateurs refusant d'étiqueter correctement leur contenu pourront voir leur compte suspendu, perdre leur monétisation ou être soumis à d'autres pénalités. YouTube explique qu'elle préviendra les créateurs en amont de cette nouveauté. Les contenus générés avec ses propres IA (par exemple doublés de manière artificielle) seront clairement indiqués comme tels.

Si la nouveauté part d'une bonne intention, YouTube ne précise pas comment elle compte repérer les vidéos générées par IA. Les deepfakes se sont perfectionnés ces dernières années et sont parfois quasiment indiscernables. Google affirme travailler sur des outils pour détecter tout cela, mais il reste à voir s'ils seront efficaces.

Une fonction va être mise en place afin de signaler un contenu généré par IA représentant une personne ou une voix en particulier. Les individus se retrouvant dans une vidéo générée par IA pourront demander à Google la suppression du contenu via un processus de réclamation pour atteinte à la vie privée. Google précise qu'elle analysera différents facteurs, par exemple s'il s'agit d'une parodie ou d'une satire, d'un individu anonyme ou d'une célébrité. Ici aussi, la question est complexe : les règles sont opaques et les cas gérés en interne. On peut se demander si tout les dossiers seront traités avec soin par une plateforme aussi grosse (500 heures de vidéos sont publiées chaque minute).

Si cette nouveauté vise à limiter la prolifération de fake news, YouTube compte également sévir contre les reprises par IA. La technologie de clonage de voix a drastiquement progressé ces derniers mois, des bidouilleurs obtenant des résultats bluffants : on a ainsi vu passer Freddie Mercury chantant All I Want For Christmas is You, ou Mickael Jackson reprenant Eye of the Tiger. Le problème est de savoir qui a les droits sur ces créations : les bidouilleurs, les ayants droit de la voix « empruntée », ceux de la version originale modifiée ? Les labels veillent sur le phénomène, et les plateformes ont d'ores et déjà commencé à faire le ménage.

Apple Music commence à supprimer des musiques générées par IA

Spotify supprime des « dizaines de milliers » de morceaux générés par l'IA

Dans son billet, YouTube explique que ses partenaires (les labels) pourront poser des demandes pour faire supprimer certains morceaux reprenant les voix d'artistes. Les règles ne sont pas très claires, mais on peut imaginer qu'elles seront sévères quand on connait la rigidité de YouTube sur le sujet des musiques protégées. Tout cela sera déployé dans le courant de l'année prochaine.